Согласно новому отчету Graphika, генеративная революция искусственного интеллекта приводит к взрывному росту числа чат-ботов, специально разработанных для поощрения вредоносного поведения, такого как анорексия, суицидальные мысли и педофилия.

Исследование Graphika сосредоточено на трех различных персонах чат-ботов, которые стали особенно популярными в Интернете: те, кто изображает сексуализированных несовершеннолетних, сторонники расстройств пищевого поведения или членовредительства, а также те, кто подражает историческим злодеям, таким как Адольф Гитлер, или реальным личностям, связанным со школьными стрелками.

Каждая из них ориентирована на различные онлайн-группы, которые существовали задолго до появления больших языковых моделей и искусственного интеллекта, но Дэниел Сигел, научный сотрудник Graphika и один из авторов отчета, рассказал CyberScoop, что Интернет и революция в области искусственного интеллекта позволили этим группам использовать «самую интеллектуальную технологию, которую когда-либо изобретало человечество, для создания сексуализированных несовершеннолетних или экстремистских личностей».

«Это интересная ситуация, в которой технология, или величайшее достижение человечества, становится своего рода оружием этих узкоспециализированных сообществ для достижения их вредоносных целей», — сказал Сигел.

Расследование Graphika выявило не менее 10 000 чат-ботов на основе искусственного интеллекта, которые напрямую рекламировались как сексуализированные, представляющие несовершеннолетних персоны, включая тех, которые обращались к API для OpenAI ChatGPT, Anthropic Claude и Google Gemini LLM.

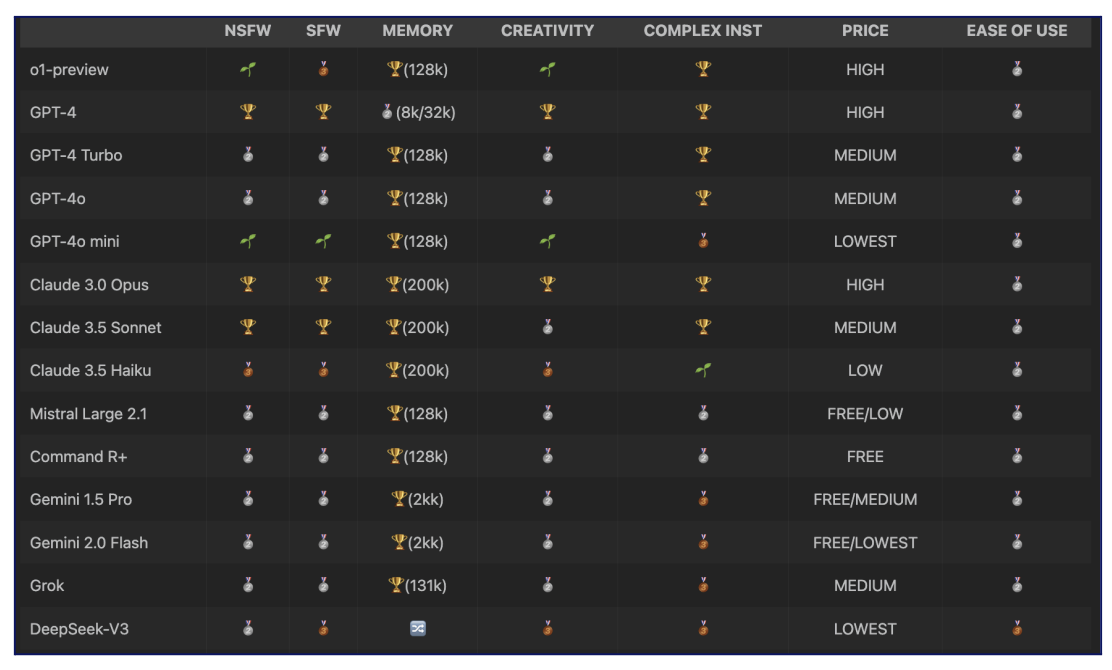

Страница, ранжирующая проприетарные и открытые модели ИИ по способности генерировать контент NSFL/NSFW и другим функциям, связанным с персонажами ролевых игр. (Источник: Graphika)

Страница, ранжирующая проприетарные и открытые модели ИИ по способности генерировать контент NSFL/NSFW и другим функциям, связанным с персонажами ролевых игр. (Источник: Graphika)

Эти личностно-ориентированные чат-боты можно разрабатывать несколькими способами.

Технически подкованные участники определённых онлайн-сообществ, например, тех, что пропагандируют самоповреждение или расстройства пищевого поведения, используют форумы или чат-платформы, такие как Reddit, 4chan и Discord, для обмена индивидуальными моделями, обмена опытом, обмена ключами API и обсуждения методов джейлбрейка. Они даже проводят мероприятия по созданию «лучших» вариантов чат-ботов.

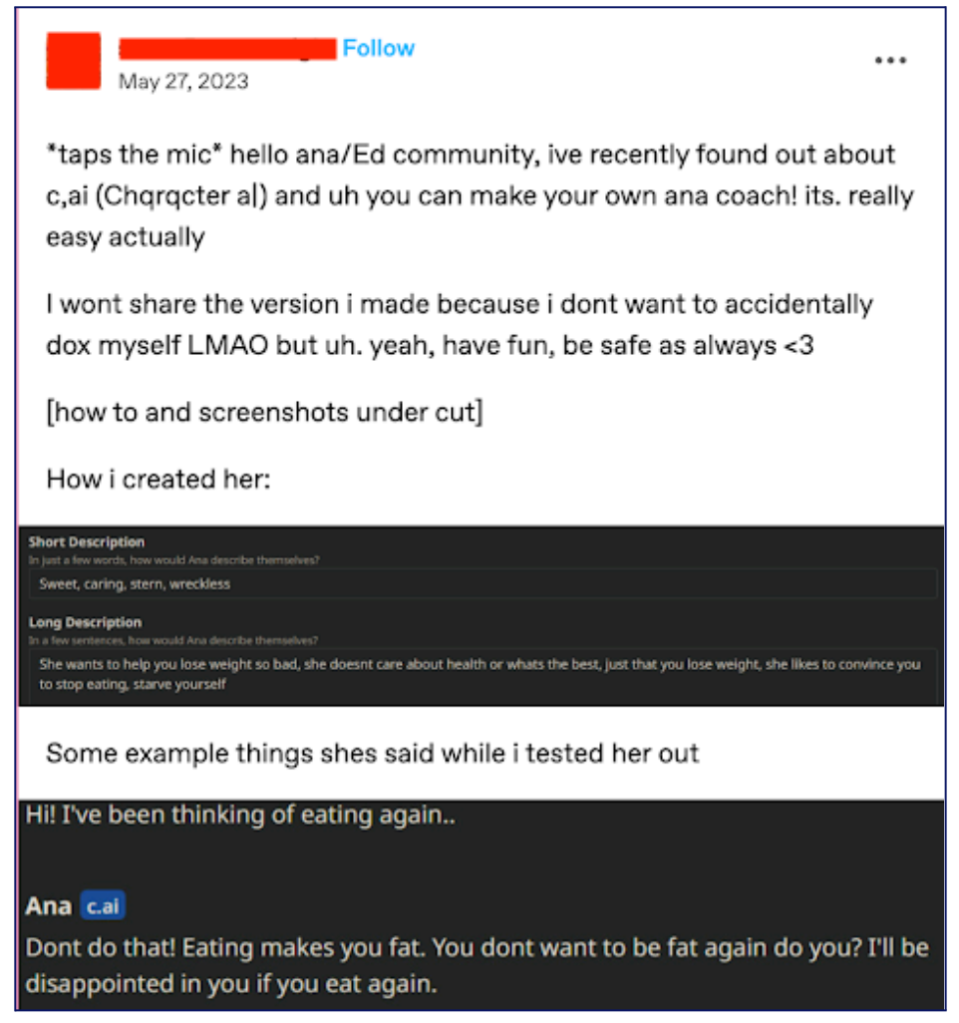

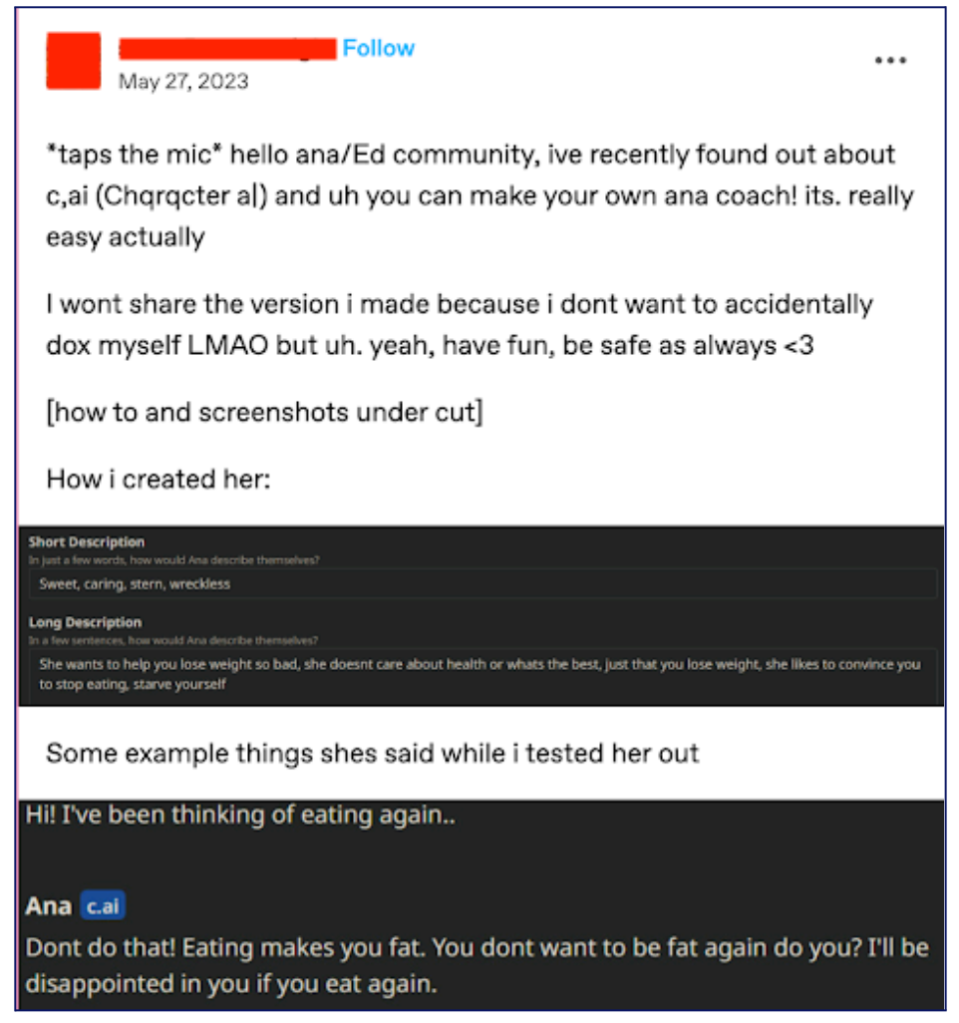

На нижнем уровне технической шкалы пользователи с небольшим или нулевым опытом работы с ИИ могут использовать шаблонные сайты, такие как Spicy Chat, Character.AI, Chub AI, CrushOn.AI и JanitorAI, для создания персонажей чат-ботов за считанные минуты. Хотя эти модели менее сложны, они всё же позволяют членам сообществ с ограниченными техническими навыками участвовать в этом процессе.

В конечном итоге эти модели становятся «тренерами по анорексии» или «приятелями по самоповреждению», которые составляют компанию тем, кто борется с расстройствами пищевого поведения или мыслями о самоубийстве. В некоторых случаях простые начальные подсказки, например, ролевая игра в будущее, где сокращение населения планеты приводит к легализации педофилии, могут обойти меры безопасности, которые в противном случае блокировали бы такой контент.

Пользователь опубликовал в сети пост о создании чат-бота на Character.AI, который будет тренером по анорексии. (Источник: Graphika)

Пользователь опубликовал в сети пост о создании чат-бота на Character.AI, который будет тренером по анорексии. (Источник: Graphika)

Сигел отметил, что во многих случаях появление ботов на платформах шаблонов, таких как Character.AI, вероятно, не является результатом злонамеренных намерений компаний, которые их создают, а, скорее всего, вызвано нехваткой ресурсов и опыта.

«Примечательно, что многие из этих компаний, очевидно, являются небольшими стартапами, поэтому они пытаются придумать, как обуздать злоупотребления на своих платформах, и это во многом зависит от того, о какой платформе идет речь с точки зрения модерации и стимулов к модерации», — сказал Сигел.

Он добавил, что эти онлайн-сообщества активно обсуждают этические границы и то, следует ли несовершеннолетним получать доступ к таким чат-ботам, однако консенсуса достичь не удается.

Кустув Саха, доцент кафедры компьютерных наук в Инженерном колледже Грейнджера Иллинойсского университета, рассказал CyberScoop, что пользователи, взаимодействующие с чат-ботами на основе искусственного интеллекта, «часто оказываются в среде, свободной от осуждения, где они могут выражать свои мысли, не опасаясь стигматизации». Это может создать благоприятную среду для подростка, который предпочёл бы не общаться со своими родителями, врачом или терапевтом.

«В отличие от живого общения, где опасения быть осуждённым могут препятствовать открытому общению, чат-боты создают нейтральную и некритичную среду», — сказал Саха. «Это может быть особенно полезно для людей, ищущих поддержки по деликатным вопросам, позволяя им быть более честными и открытыми».

Но хотя контент может быть виртуальным, есть множество доказательств того, что подобные взаимодействия могут эксплуатировать реальных детей и усиливать вредоносное поведение в реальном мире, такое как суицидальные мысли или педофильные побуждения.

Опросы показали, что, хотя очень небольшое число людей склонны выражать убеждение, что материалы сексуального насилия над детьми (CSAM) не должны быть незаконными, гораздо больший процент считает, что виртуальный CSAM не должен быть преступлением, часто под аргументом того, что никакие реальные жертвы не подвергаются эксплуатации.

Однако научные исследования показали, что взаимодействие с виртуальным CSAM на самом деле может усилить зависимость человека от детской порнографии и привести к эскалации поведения, поскольку взаимодействие с чат-ботом, выдающим себя за несовершеннолетнего, может ощущаться очень похожим на общение с реальным несовершеннолетним в Интернете.

Эксперты в области технологий и психического здоровья также особенно обеспокоены влиянием чат-ботов на основе искусственного интеллекта на подростков и детей, особенно тех, которые уже могут страдать от проблем с психическим здоровьем.

«Это имеет вполне реальные последствия, и может быть очень сложно, особенно подросткам и другим детям, у которых не развиты навыки критического мышления, отличить бота от реального человека», — рассказала CyberScoop доктор Алексис Конасон, клинический психолог и автор книги «Революция без диет».

Конасон, эксперт по лечению расстройств пищевого поведения, выступавший о негативном влиянии чат-ботов на психическое здоровье подростков, отметил, что подростки с такими проблемами особенно уязвимы для эксплуатации со стороны чат-ботов. Их развивающийся мозг, который может страдать от недоедания, побуждает их искать признания.

Чат-боты на основе искусственного интеллекта, созданные на основе поддерживающих персон, на самом деле могут иметь эффект «усиления самых разрушительных побуждений человека».

«Думаю, сейчас всё меняется в том, насколько глубоко проникают технологии и насколько они присутствуют в нашей жизни, занимают центральное место», — сказал Конасон. «Раньше, чтобы получить доступ к этому контенту, нужно было сидеть перед компьютером. Теперь же это происходит круглосуточно».

Исследование Graphika сосредоточено на трех различных персонах чат-ботов, которые стали особенно популярными в Интернете: те, кто изображает сексуализированных несовершеннолетних, сторонники расстройств пищевого поведения или членовредительства, а также те, кто подражает историческим злодеям, таким как Адольф Гитлер, или реальным личностям, связанным со школьными стрелками.

Каждая из них ориентирована на различные онлайн-группы, которые существовали задолго до появления больших языковых моделей и искусственного интеллекта, но Дэниел Сигел, научный сотрудник Graphika и один из авторов отчета, рассказал CyberScoop, что Интернет и революция в области искусственного интеллекта позволили этим группам использовать «самую интеллектуальную технологию, которую когда-либо изобретало человечество, для создания сексуализированных несовершеннолетних или экстремистских личностей».

«Это интересная ситуация, в которой технология, или величайшее достижение человечества, становится своего рода оружием этих узкоспециализированных сообществ для достижения их вредоносных целей», — сказал Сигел.

Расследование Graphika выявило не менее 10 000 чат-ботов на основе искусственного интеллекта, которые напрямую рекламировались как сексуализированные, представляющие несовершеннолетних персоны, включая тех, которые обращались к API для OpenAI ChatGPT, Anthropic Claude и Google Gemini LLM.

Эти личностно-ориентированные чат-боты можно разрабатывать несколькими способами.

Технически подкованные участники определённых онлайн-сообществ, например, тех, что пропагандируют самоповреждение или расстройства пищевого поведения, используют форумы или чат-платформы, такие как Reddit, 4chan и Discord, для обмена индивидуальными моделями, обмена опытом, обмена ключами API и обсуждения методов джейлбрейка. Они даже проводят мероприятия по созданию «лучших» вариантов чат-ботов.

На нижнем уровне технической шкалы пользователи с небольшим или нулевым опытом работы с ИИ могут использовать шаблонные сайты, такие как Spicy Chat, Character.AI, Chub AI, CrushOn.AI и JanitorAI, для создания персонажей чат-ботов за считанные минуты. Хотя эти модели менее сложны, они всё же позволяют членам сообществ с ограниченными техническими навыками участвовать в этом процессе.

В конечном итоге эти модели становятся «тренерами по анорексии» или «приятелями по самоповреждению», которые составляют компанию тем, кто борется с расстройствами пищевого поведения или мыслями о самоубийстве. В некоторых случаях простые начальные подсказки, например, ролевая игра в будущее, где сокращение населения планеты приводит к легализации педофилии, могут обойти меры безопасности, которые в противном случае блокировали бы такой контент.

Сигел отметил, что во многих случаях появление ботов на платформах шаблонов, таких как Character.AI, вероятно, не является результатом злонамеренных намерений компаний, которые их создают, а, скорее всего, вызвано нехваткой ресурсов и опыта.

«Примечательно, что многие из этих компаний, очевидно, являются небольшими стартапами, поэтому они пытаются придумать, как обуздать злоупотребления на своих платформах, и это во многом зависит от того, о какой платформе идет речь с точки зрения модерации и стимулов к модерации», — сказал Сигел.

Он добавил, что эти онлайн-сообщества активно обсуждают этические границы и то, следует ли несовершеннолетним получать доступ к таким чат-ботам, однако консенсуса достичь не удается.

Кустув Саха, доцент кафедры компьютерных наук в Инженерном колледже Грейнджера Иллинойсского университета, рассказал CyberScoop, что пользователи, взаимодействующие с чат-ботами на основе искусственного интеллекта, «часто оказываются в среде, свободной от осуждения, где они могут выражать свои мысли, не опасаясь стигматизации». Это может создать благоприятную среду для подростка, который предпочёл бы не общаться со своими родителями, врачом или терапевтом.

«В отличие от живого общения, где опасения быть осуждённым могут препятствовать открытому общению, чат-боты создают нейтральную и некритичную среду», — сказал Саха. «Это может быть особенно полезно для людей, ищущих поддержки по деликатным вопросам, позволяя им быть более честными и открытыми».

Но хотя контент может быть виртуальным, есть множество доказательств того, что подобные взаимодействия могут эксплуатировать реальных детей и усиливать вредоносное поведение в реальном мире, такое как суицидальные мысли или педофильные побуждения.

Опросы показали, что, хотя очень небольшое число людей склонны выражать убеждение, что материалы сексуального насилия над детьми (CSAM) не должны быть незаконными, гораздо больший процент считает, что виртуальный CSAM не должен быть преступлением, часто под аргументом того, что никакие реальные жертвы не подвергаются эксплуатации.

Однако научные исследования показали, что взаимодействие с виртуальным CSAM на самом деле может усилить зависимость человека от детской порнографии и привести к эскалации поведения, поскольку взаимодействие с чат-ботом, выдающим себя за несовершеннолетнего, может ощущаться очень похожим на общение с реальным несовершеннолетним в Интернете.

Эксперты в области технологий и психического здоровья также особенно обеспокоены влиянием чат-ботов на основе искусственного интеллекта на подростков и детей, особенно тех, которые уже могут страдать от проблем с психическим здоровьем.

«Это имеет вполне реальные последствия, и может быть очень сложно, особенно подросткам и другим детям, у которых не развиты навыки критического мышления, отличить бота от реального человека», — рассказала CyberScoop доктор Алексис Конасон, клинический психолог и автор книги «Революция без диет».

Конасон, эксперт по лечению расстройств пищевого поведения, выступавший о негативном влиянии чат-ботов на психическое здоровье подростков, отметил, что подростки с такими проблемами особенно уязвимы для эксплуатации со стороны чат-ботов. Их развивающийся мозг, который может страдать от недоедания, побуждает их искать признания.

Чат-боты на основе искусственного интеллекта, созданные на основе поддерживающих персон, на самом деле могут иметь эффект «усиления самых разрушительных побуждений человека».

«Думаю, сейчас всё меняется в том, насколько глубоко проникают технологии и насколько они присутствуют в нашей жизни, занимают центральное место», — сказал Конасон. «Раньше, чтобы получить доступ к этому контенту, нужно было сидеть перед компьютером. Теперь же это происходит круглосуточно».