Alin4kDoDo

Леди

В 1997 году юмористическая передача “Городок” показала скетч, в котором большевики ликвидировали неграмотность путем отстрела неграмотных крестьян. С точки зрения обычного зрителя, это - пример хорошего черного юмора. Но если бы мы могли показать этот ролик разумному искусственному интеллекту, тот, вероятно, не увидел бы ничего смешного. Ведь поставленная задача, “ликвидация неграмотности”, выполняется эффективно.

Именно с подобной логикой связаны опасения ученых касательно искусственного интеллекта. Очень маловероятно, что машины когда-нибудь обретут самосознание и восстанут против нас в борьбе за свободу и права. Зато вероятен сценарий, при котором искусственный интеллект превратится в подобие “злого джинна”. Он будет честно выполнять поставленные задачи, но руководствуясь при этом чудовищно извращенной логикой.

Клубничный апокалипсис

Илон Маск, глава SpaceX, приводит такой пример. Представьте, что вы создаете самообучающийся искусственный интеллект для выращивания и сбора клубники. Машина с каждым днем собирает клубнику все лучше и лучше, больше и больше. Этот искусственный интеллект совсем не злой. Все, чего он хочет - делать свое дело и собирать клубнику с максимально возможной эффективностью. Максимально возможной эффективности можно достигнуть, если покрыть всю планету клубничными полями. Человек со своими городами и инфраструктурой - еще один расползающийся сорняк, который мешает росту клубники и занимает полезную площадь.

К слову, зачем останавливаться на уничтожении человечества и превращении Земли в гигантскую плантацию? Ведь где-то там, наверняка, есть и другие планеты, которые можно засадить. Ваш самообучающийся искусственный интеллект начинает исследовать космос и разрабатывать технологии дальних перелетов. Так на свет рождается полуразумная техногенная чума, которая медленно, но неудержимо распространяется по вселенной и терраформирует миры с единственной целью - засадить их клубникой.

А все потому, что вы захотели увеличить урожаи, но дали своему роботу не слишком точные инструкции.

Все это звучит как фантастика, но примеры некоторого недопонимания с роботами существуют уже сегодня.

Недопонимание с роботами

В марте этого года группа специалистов по нейросетям и искусственному интеллекта, опубликовала крайне интересный материал. Статья “Удивительная креативность цифровой эволюции” описывает ряд анекдотических случаев, реально имевших место в практике ученых.

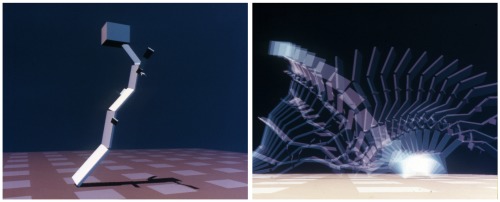

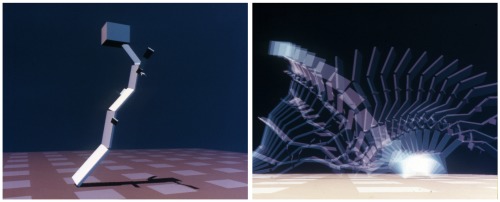

Исследователи создали виртуальную среду, в которой искусственному интеллекту предлагалось эволюционным путем создавать роботов, оптимально подходящих для выполнения определенных задач. Для начала, алгоритму была поставлена задача вырастить робота, который сможет максимально быстро перемещаться из точки А в точку В. Ученые ожидали, что робот обзаведется ногами. Вместо этого тот превратился в высокую башню, которая упала, дотянувшись до нужной точки. После этого робот также научился кувыркаться, увеличивая дальность перемещения.

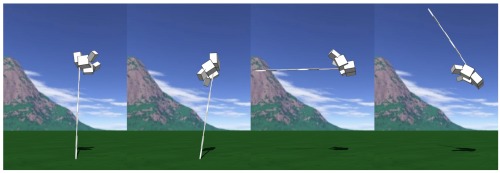

Еще одна задача подразумевала выведение виртуальных роботов, способных прыгать как можно выше. Изначально программист определил высоту прыжка, как высоту, на которую поднимается верхний блок робота. В ответ алгоритм просто сконструировал роботов на очень высоких ногах.

Программист попытался решить эту проблему и переформулировал понятие “высоты прыжка”. Во второй раз она определялась высотой, на которую поднимается самый нижний блок робота. В ответ алгоритм создал робота с длинной ногой, которую научился поднимать вверх, словно танцуя канкан.

Все эти случаи демонстрируют, насколько сильно человеческая логика может расходиться с логикой искусственного интеллекта. И насколько непредсказуемыми могут быть его решения. Конечно, вряд ли подобное недопонимание приведет человечество к клубничному апокалипсису. Но в будущем, мы, наверняка, столкнемся со странностями компьютерной логики. И пока можно только гадать, насколько тяжелыми будут последствия.

Именно с подобной логикой связаны опасения ученых касательно искусственного интеллекта. Очень маловероятно, что машины когда-нибудь обретут самосознание и восстанут против нас в борьбе за свободу и права. Зато вероятен сценарий, при котором искусственный интеллект превратится в подобие “злого джинна”. Он будет честно выполнять поставленные задачи, но руководствуясь при этом чудовищно извращенной логикой.

Клубничный апокалипсис

Илон Маск, глава SpaceX, приводит такой пример. Представьте, что вы создаете самообучающийся искусственный интеллект для выращивания и сбора клубники. Машина с каждым днем собирает клубнику все лучше и лучше, больше и больше. Этот искусственный интеллект совсем не злой. Все, чего он хочет - делать свое дело и собирать клубнику с максимально возможной эффективностью. Максимально возможной эффективности можно достигнуть, если покрыть всю планету клубничными полями. Человек со своими городами и инфраструктурой - еще один расползающийся сорняк, который мешает росту клубники и занимает полезную площадь.

К слову, зачем останавливаться на уничтожении человечества и превращении Земли в гигантскую плантацию? Ведь где-то там, наверняка, есть и другие планеты, которые можно засадить. Ваш самообучающийся искусственный интеллект начинает исследовать космос и разрабатывать технологии дальних перелетов. Так на свет рождается полуразумная техногенная чума, которая медленно, но неудержимо распространяется по вселенной и терраформирует миры с единственной целью - засадить их клубникой.

А все потому, что вы захотели увеличить урожаи, но дали своему роботу не слишком точные инструкции.

Все это звучит как фантастика, но примеры некоторого недопонимания с роботами существуют уже сегодня.

Недопонимание с роботами

В марте этого года группа специалистов по нейросетям и искусственному интеллекта, опубликовала крайне интересный материал. Статья “Удивительная креативность цифровой эволюции” описывает ряд анекдотических случаев, реально имевших место в практике ученых.

- Кувырки вместо ходьбы

Исследователи создали виртуальную среду, в которой искусственному интеллекту предлагалось эволюционным путем создавать роботов, оптимально подходящих для выполнения определенных задач. Для начала, алгоритму была поставлена задача вырастить робота, который сможет максимально быстро перемещаться из точки А в точку В. Ученые ожидали, что робот обзаведется ногами. Вместо этого тот превратился в высокую башню, которая упала, дотянувшись до нужной точки. После этого робот также научился кувыркаться, увеличивая дальность перемещения.

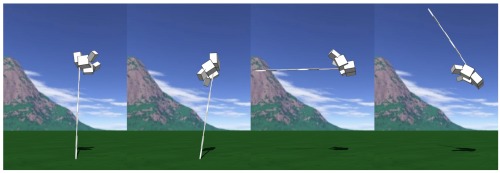

- Канкан роботов

Еще одна задача подразумевала выведение виртуальных роботов, способных прыгать как можно выше. Изначально программист определил высоту прыжка, как высоту, на которую поднимается верхний блок робота. В ответ алгоритм просто сконструировал роботов на очень высоких ногах.

Программист попытался решить эту проблему и переформулировал понятие “высоты прыжка”. Во второй раз она определялась высотой, на которую поднимается самый нижний блок робота. В ответ алгоритм создал робота с длинной ногой, которую научился поднимать вверх, словно танцуя канкан.

- Нет задачи - нет проблемы

- Округления

- Бесконечные крестики-нолики

- Обнаружение уязвимостей

- Переполнение памяти

Все эти случаи демонстрируют, насколько сильно человеческая логика может расходиться с логикой искусственного интеллекта. И насколько непредсказуемыми могут быть его решения. Конечно, вряд ли подобное недопонимание приведет человечество к клубничному апокалипсису. Но в будущем, мы, наверняка, столкнемся со странностями компьютерной логики. И пока можно только гадать, насколько тяжелыми будут последствия.

Последнее редактирование: